OpenAIの動画生成AI「Sora2」。先日、Sora2で生成した自分が歌う姿を見て、忘れかけていた音楽への情熱が蘇ってきた……という話を投稿しました。

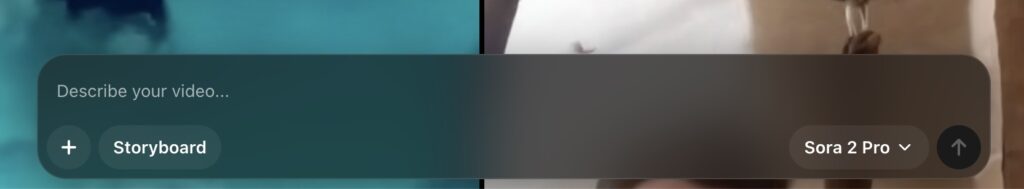

Sunoの有料版も契約し、着々と生成AIを活用した音楽活動の準備を進めています。今日は、Sora2のStoryboardという機能を使って、先日Sunoで作成した曲に映像を当てはめるテストを行いましたのでここにまとめておきます。

Sora2のStoryboard機能とは?

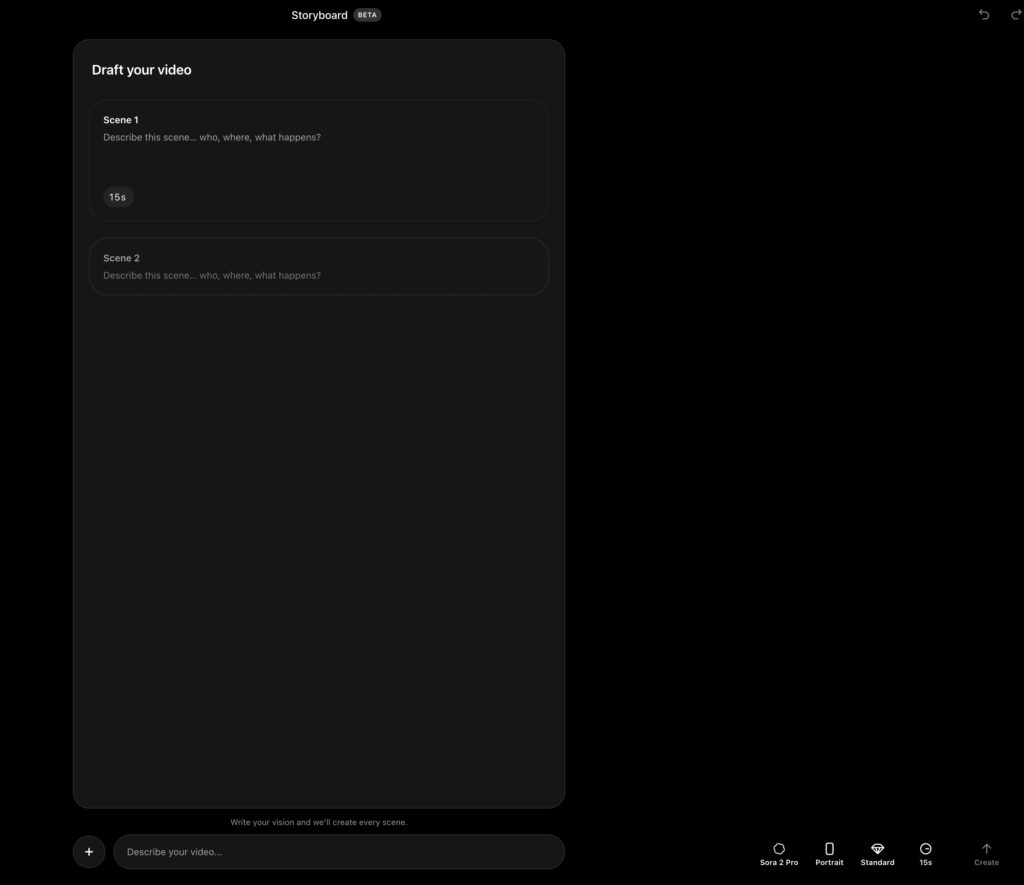

Sora2のStoryboardは、動画を複数の時間区間(シーン)に分割し、それぞれに自然言語で指示を書くことで、時間構造を持った一本の動画を生成する機能で、単一プロンプトでは制御しきれない「展開・リズム・構成」を、秒単位で設計できる点が最大の特徴です。

※言語設定を英語のまま作業してしまったためスクリーンショットは英語ですが、日本語設定であればメニューも日本語になります。

主な特徴(ポイント)

- 時間指定ができる

各シーンの長さを設定し、時間の配分を指定可能。動画全体の長さは10秒、15秒、25秒から選択(高解像度選択時は25秒不可)。 - シーンごとにプロンプトを分割

登場人物の動き、カメラ、感情の変化などをシーンごとに制御可能。 - その他

解像度は「高」「標準」の2種類。モデルはSora2とSora2 Proから選択可能。

オリジナルソングのPV制作に挑戦

今回は、先週Sunoで作ったオリジナルソングに合わせて、最長である25秒のショートPVを作ってみることにしました。将来的には複数のクリップを繋いでフルサイズにする予定ですが、まずはテストです。

ChatGPT 5.2に構成を丸投げしてみる

本来は人間が構成を練るべきですが、シーンごとの生成精度を試すのが今回の目的のため、Sunoの曲ファイルをChatGPT 5.2にアップロードして分析させ、プロンプトを書いてもらいました。

ChatGPTがStoryboardの仕様を完璧には把握しておらず、何度か修正が必要でしたが、最終的に7つのシーンに分かれたプロンプトが完成。早速Sora2にセットしました。

まさかの生成失敗…

この25秒の動画の生成には結構時間がかかります。しばらく待った後、完成したのですがこれが大失敗でした。なんと、Sora2が勝手に生成した全く別の音楽が流れており、映像の中の僕(のアバター)はその曲に合わせて口パクをしてしまっていたのです。

僕がやりたかったのは「オリジナルソングのイメージビデオ」だったのですが、Sora2の機能により、別の曲を歌う動画になってしまいました。さすがに口が全く合わないのでこの動画で試すのは断念。

直前のテスト動画を再利用してDavinci Resolveで編集

とはいえ、現在時刻は午前2時。朝までには一本仕上げたい。 しかし生成には結構な時間がかかります。そこで仕方なく、直前にテスト的に作っておいた映像素材を引っ張り出し、Davinci ResolveでSunoの曲と合わせて編集することにしました。

そして完成した動画がこちらです。よかったら見てみてください!

いかがでしょうか?最後同じシーンが長過ぎるとは思いますが、全然関係なく作ったものなのでそこはご容赦ください。でも前半のシーンとか、実際結構PV素材として使えそうじゃないですか?

あ、AIの僕が実物よりいい感じなのは許してください。僕は何の指示もしていません(笑)。

まとめ

Sora2のStoryboard機能で生成した動画とSunoで生成したオリジナルソングのPV作成は一部失敗しましたが、Sunoで作った曲にAI動画をあてるプロセス自体は確立できました。

次回は「映像の中の自分が歌わない(リップシンクさせない)」指示をプロンプトに追加し、さらに長尺の生成(複数の動画)にも挑戦したいと思います。作業は年末になりそうですが、ぜひお楽しみに!

コメント